Kontynuując cykl dotyczący modularnych centrów danych i modularnych serwerowni przedstawiam propozycję firmy Rittal o nazwie RiMatrix S. Tak się szczęśliwie złożyło, że firma ta zorganizowała w ostatnim czasie roadshow po Polsce z przykładową wersją kontenera i miałem okazję zobaczyć produkt …

Autor: sicd.pl

Bezpieczne pomieszczenie serwerowni – IT security room

Zazwyczaj serwerownie wykonuje się w istniejącym pomieszczeniu, które wcześniej było biurem, magazynem lub czymkolwiek innym. Wymaga to szeregu kompromisów pomiędzy możliwościami obiektu a pożądaną funkcjonalnością i bezpieczeństwem infrastruktury. Znacznie lepszą sytuację mamy, gdy planowane centrum danych będzie budowane od początku …

Wirtualny spacer po serwerowni Europejskiej Organizacji Badań Jądrowych

Tym razem prezentuję krótki, aczkolwiek treściwy materiał. Mianowicie Europejska Organizacja Badań Jądrowych (CERN) za pomocą systemu Google Street View udostępniła możliwość wirtualnego zwiedzania swojej serwerowni, w taki sam sposób jak ulice, które można podglądać na mapach Google.

W omawianej serwerowni …

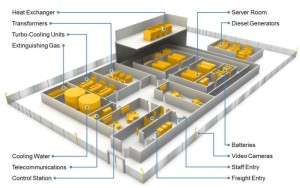

Budowa centrum przetwarzania danych na przykładzie obiektu firmy SAP

Budowa centrum przetwarzania danych, czyli z jakich części składa się data center? Wyjaśniam na kolejnym przykładzie. Kolejnym, ponieważ zagadnienie podziału data center poruszyłem przy okazji pisania mojej definicji centrum danych oraz analizy różnicy pomiędzy serwerownią a centrum danych.

Mimo, …

Modularne centrum danych – propozycja HP

Kontynuujące tematykę modularnego centrum danych (wpis dotyczący propozycji Microsoft) przedstawiam tym razem propozycję firmy Hawlett-Packard o nazwie HP Performance Optimized Datacenter (POD).

Jeden moduł tego typu jest w stanie pomieścić 44 szafy o wysokości 50U i nośności 1,5 …

Modularne centrum danych – propozycja Microsoft

Modularne centrum danych jest to centrum danych składające się z pewnej liczby niezależnych i kompletnych modułów (np. kontenerów) - będących de facto w takim układzie serwerowniami, które wystarczy podłączyć do infrastruktury centrum danych (zasilanie, sieć komputerowa, źródło chłodu - opcjonalnie) …