Open Compute Project (dosłownie "otwarty projekt obliczeniowy) to przedsięwzięcie inżynierów Facebooka mające na celu opracowanie otwartych i ogólnie dostępnych dla wszystkich standardów budowy centrum danych i jego wyposażenia, które przy najniższych kosztach inwestycji zapewnią najwyższą efektywność energetyczną i moc obliczeniową.…

Kategoria: Budowa

W tej kategorii znajdziesz praktyczne porady dotyczące procesu budowy serwerowni czy centrum danych.

Modularne centrum danych – propozycja Rittal RiMatrix S

Kontynuując cykl dotyczący modularnych centrów danych i modularnych serwerowni przedstawiam propozycję firmy Rittal o nazwie RiMatrix S. Tak się szczęśliwie złożyło, że firma ta zorganizowała w ostatnim czasie roadshow po Polsce z przykładową wersją kontenera i miałem okazję zobaczyć produkt …

Bezpieczne pomieszczenie serwerowni – IT security room

Zazwyczaj serwerownie wykonuje się w istniejącym pomieszczeniu, które wcześniej było biurem, magazynem lub czymkolwiek innym. Wymaga to szeregu kompromisów pomiędzy możliwościami obiektu a pożądaną funkcjonalnością i bezpieczeństwem infrastruktury. Znacznie lepszą sytuację mamy, gdy planowane centrum danych będzie budowane od początku …

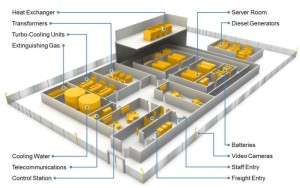

Budowa centrum przetwarzania danych na przykładzie obiektu firmy SAP

Budowa centrum przetwarzania danych, czyli z jakich części składa się data center? Wyjaśniam na kolejnym przykładzie. Kolejnym, ponieważ zagadnienie podziału data center poruszyłem przy okazji pisania mojej definicji centrum danych oraz analizy różnicy pomiędzy serwerownią a centrum danych.

Mimo, …

Przykład centrów danych firmy SoftLayer

Tym razem prezentuję filmiki zamieszczone przez firmę SoftLayer przedstawiające ich dwa centra danych oraz proces kablowania szaf serwerowych i montażu w nich serwerów. Materiał ten jest bardzo ciekawy ponieważ pokazuje różne części cdata center z wieloma detalami. Ponadto przybliża on …

Montaż Stałego Urządzenia Gaśniczego – przykład

Kontynuując tematykę zabezpieczeń przeciwpożarowych serwerowni zamieszczam odnośnik do krótkiego filmiku prezentującego montaż Stałego Urządzenia Gaśniczego. Co prawda przedstawiony montaż odbywa się w pomieszczeniu archiwum, niemniej jednak sposób wykonywania instalacji jest adekwatny do przypadku serwerowni. Oczywiście szczegóły projektowe i elementy instalacji …